隨著大規模語言模型(LLM)的蓬勃發展,訓練千億乃至萬億參數級別的模型已成為AI領域的前沿陣地。模型規模的指數級增長對底層的數據處理與存儲支持服務提出了前所未有的挑戰。優雅地訓練大模型,不僅需要先進的算法與算力,更依賴于一套高效、可靠、可擴展的數據流水線與存儲架構。本文將探討如何構建這樣一個支持體系,以應對LLM訓練中的數據洪流。

一、 數據預處理:規模化與智能化的平衡

大模型訓練始于海量、多模態、高質量的原始數據。優雅的數據處理首要在于預處理流程的工業級設計。

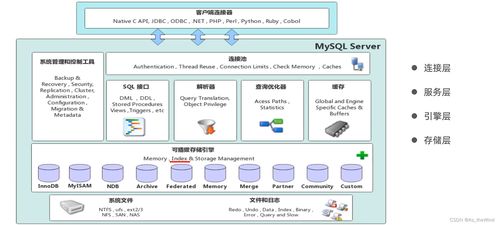

- 分布式數據攝取與清洗:利用如Apache Spark、Flink等分布式計算框架,構建可橫向擴展的數據攝取管道,并行處理TB/PB級原始文本、代碼、圖像等多源數據。清洗過程需自動化識別并過濾低質量、重復、有害信息,同時結合小規模模型或規則引擎進行智能去重與內容安全過濾。

- 高效的Tokenizer與序列化:針對LLM,選擇或訓練合適的Tokenizer(如BPE、SentencePiece),并將其集成到高效的C++/Rust后端中,實現分布式分詞與編碼。將文本數據預處理為可直接用于訓練的序列化格式(如TFRecord、HDF5、Arrow),并建立索引,以支持后續的快速隨機訪問。

- 版本化與可復現性:所有原始數據、清洗后的數據、分詞詞典及處理代碼都應進行嚴格的版本控制(如DVC、Git LFS)。確保任何一次訓練任務的數據 lineage 清晰可溯,這是科學實驗與工程可復現性的基石。

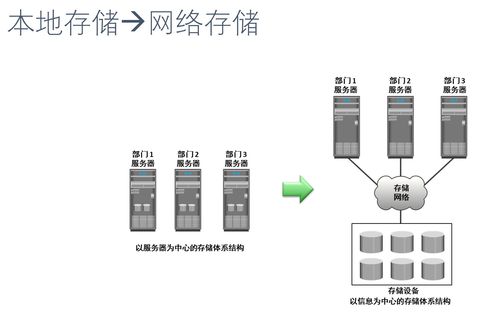

二、 存儲架構:性能、成本與可靠性的三重奏

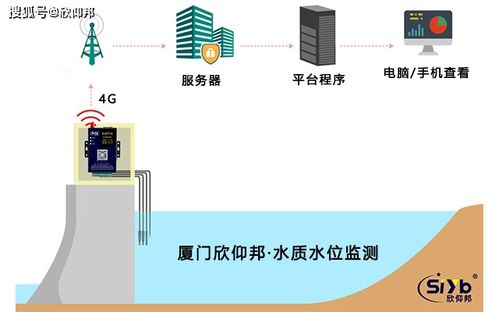

訓練過程中,數據需要被高速、反復讀取。存儲系統的設計直接決定了訓練效率的上限。

- 分層存儲策略:

- 熱存儲(高性能):使用全閃存陣列或高性能分布式文件系統(如Lustre、GPFS、WekaFS)存放當前訓練周期正在頻繁訪問的預處理后數據集。其超低延遲和高IOPS是保證GPU算力不被閑置的關鍵。

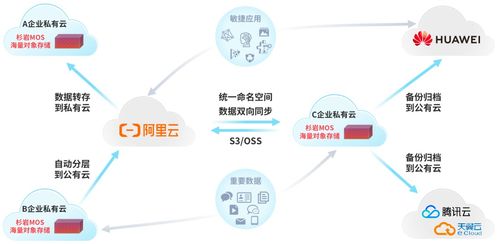

- 溫存儲(高吞吐):采用基于對象的存儲(如AWS S3、Google Cloud Storage、MinIO)或HDFS,作為中心化的數據湖,存放所有版本的處理后數據集、檢查點、日志等。它提供高吞吐的順序讀寫能力,適合數據加載和模型保存。

- 冷存儲(低成本):將不常訪問的原始數據、歷史檢查點歸檔至磁帶庫或冰川類存儲服務,以極低成本滿足長期保存需求。

- 緩存與數據局部性優化:在計算節點(GPU服務器)本地NVMe SSD上設置智能緩存層。訓練開始前,將當前任務所需的數據塊預加載至本地緩存;訓練過程中,采用優化的數據加載器(如PyTorch的DataLoader,結合WebDataset格式)實現流水線化,使數據準備與GPU計算完全重疊,消除I/O瓶頸。

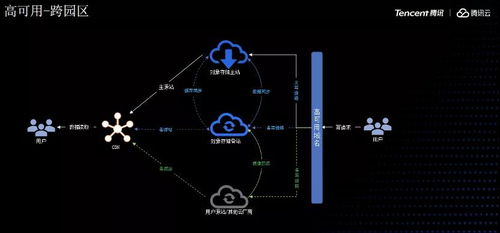

- 持久化與容錯:所有關鍵數據(原始數據、中間數據、模型檢查點)必須在分布式存儲中擁有多副本或糾刪碼保護。定期將訓練檢查點同步至對象存儲,確保在發生硬件故障時能快速從最近狀態恢復,避免數日計算成果毀于一旦。

三、 服務化與協同:提升研發效率

優雅的體系最終要服務于研發團隊,降低其數據管理負擔。

- 數據服務化:構建內部的數據平臺或服務,提供統一的目錄查詢、數據預覽、樣本檢索、質量報告和自助式數據訂閱功能。研究人員可以通過API或界面輕松獲取所需版本的數據集,而無需關心底層存儲位置與格式。

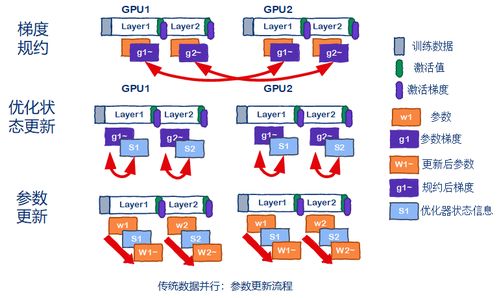

- 與訓練框架深度集成:數據處理管道應與PyTorch、TensorFlow、JAX等訓練框架無縫對接。例如,利用NVIDIA的DALI庫進行GPU加速的數據預處理,或使用Ray Data、TensorFlow tf.data API構建端到端的分布式數據流水線,讓數據像水流一樣自然流入模型。

- 監控與洞察:建立全面的監控系統,跟蹤數據流水線各階段的吞吐量、延遲、錯誤率以及存儲系統的容量、IO性能。利用這些指標持續優化數據流水線,并快速定位瓶頸。

四、 面向未來的考量

- 持續學習與數據迭代:LLM需要持續進化。數據處理體系應支持增量數據的無縫接入、與已有數據的融合去重,以及面向新任務的動態數據采樣與混合策略。

- 合規與隱私:在處理海量公開數據時,必須內置數據版權過濾、個人信息脫敏機制,并建立數據使用審計跟蹤,以滿足日益嚴格的法規要求。

- 成本優化:通過數據壓縮(如Zstandard)、智能生命周期管理(自動將冷數據遷移至廉價存儲)、按需供給等策略,在保證性能的控制龐大數據工程的總擁有成本。

在LLM盛行的今天,“優雅地訓練大模型”是一場系統工程的藝術。其核心在于認識到數據是模型的“第一性原理”,并圍繞這一原理,構建一個兼具自動化處理能力、高性能存儲訪問、強韌服務化支持的數據基礎設施。唯有如此,才能讓寶貴的算力資源完全聚焦于模型本身的創新與突破,從而在AI競賽中贏得先機。